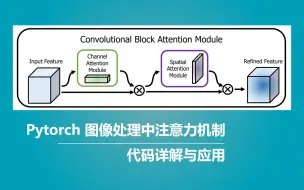

03 Transformer 中的多头注意力(Multi-Head Attention)Pytorch代码实现

提示! 右键单击并选择“Save link as...”进行下载。

| VIDEOS | |||

| MP4 | N/A | 480P | 下载 |

| MP4 | N/A | 360P | 下载 |

| AUDIO | |||

| MP4 | N/A | mp4a.40.2 | 下载 |

| MP4 | N/A | mp4a.40.2 | 下载 |

| MP4 | N/A | mp4a.40.2 | 下载 |

| THUMBNAILS | |||

|

JPEG | Origin Image | 下载 |

Transformer 的多头注意力机制(自注意力机制)的 Pytorch 实现。

博客配套视频链接: https://space.bilibili.com/383551518?spm_id_from=333.1007.0.0 b 站直接看

配套 github 链接:https://github.com/nickchen121/Pre-training-language-model

配套博客链接:https://www.cnblogs.com/nickchen121/p/15105048.html

博客配套视频链接: https://space.bilibili.com/383551518?spm_id_from=333.1007.0.0 b 站直接看

配套 github 链接:https://github.com/nickchen121/Pre-training-language-model

配套博客链接:https://www.cnblogs.com/nickchen121/p/15105048.html